Naciones Unidas, 5 nov (EFE).- Los casi cuarenta miembros del Órgano Asesor sobre inteligencia artificial (IA) creado por Naciones Unidas ya están trabajando para conseguir un “consejo científico” que dé recomendaciones sobre esta tecnología, y esperan que de ahí salga un “plan de implementación” internacional.

Este consejo de sabios, que integran expertos del sector público y el privado, está subdividido en tres pilares que discutirán la gobernanza internacional de esta tecnología, los riesgos y desafíos de la IA y las oportunidades para aprovechar la tecnología.

Las 20 mujeres y 19 hombres, procedentes de 33 países, no tienen el tiempo a su favor: primero, se trata de una tecnología que no deja de avanzar, y segundo, cuentan con muy poco tiempo para emitir un informe.

Este diciembre emitirán un primer “borrador” y en el marco de la Cumbre del Futuro del próximo septiembre presentarán sus recomendaciones.

No obstante, Carme Artigas, secretaria de estado de Digitalización e IA de España y copresidenta de este Órgano Asesor, indica a EFE que, al no tratarse de un documento con una “carga teórica” que se tenga que demostrar, ve factible entregar el documento final a tiempo.

“Estamos muy interesados en que esto no quede en un papel de recomendación, sino que de la mano de este informe del 24 (de septiembre) podamos sacar también un plan de implementación”, recalca Artigas, que copreside el consejo junto con el zimbabuense James Manyika, vicepresidente senior de Google-Alphabet.

De acuerdo con Artigas, el mundo se tendría que dar “como máximo” un año para poner en marcha estos mecanismos, porque va llegando un momento en que no se necesitan tantos foros nuevos que debatan esta tecnología, y se trata más bien de “alinear posturas para trabajar juntos”.

Una IA muy del hemisferio norte

Por ahora, el hemisferio norte es el que lleva la voz cantante en esta tecnología.

Estados Unidos es el país que acuna muchas de las empresas que lideran esta tecnología. En el caso de la IA generativa, fue OpenAI la que dio el pistoletazo de salida con ChatGPT, en noviembre del año pasado, y este año los gigantes Microsoft y Google han entrado en la carrera por dominar este mercado.

Mientras que Europa es la región más insistente en crear regulaciones, y otros continentes como África o Latinoamérica parecen estar rezagados.

La ONU trata ahora de que esta disparidad no se refleje en su consejo de sabios al seleccionar a expertos de más de treinta países.

Para la argentina María Vanina Martínez Posse, investigadora en IA en el Instituto de Investigaciones Artificiales de España, esto es algo clave, ya que uno de los riesgos de la IA es la “dependencia tecnológica” que puede crear para países latinoamericanos.

Martínez Posse forma parte del subgrupo especializado en los riesgos y desafíos de esta tecnología, aunque también ayudará en el de las oportunidades para aprovechar la IA para acelerar el cumplimiento de los Objetivos de Desarrollo Sostenible (ODS).

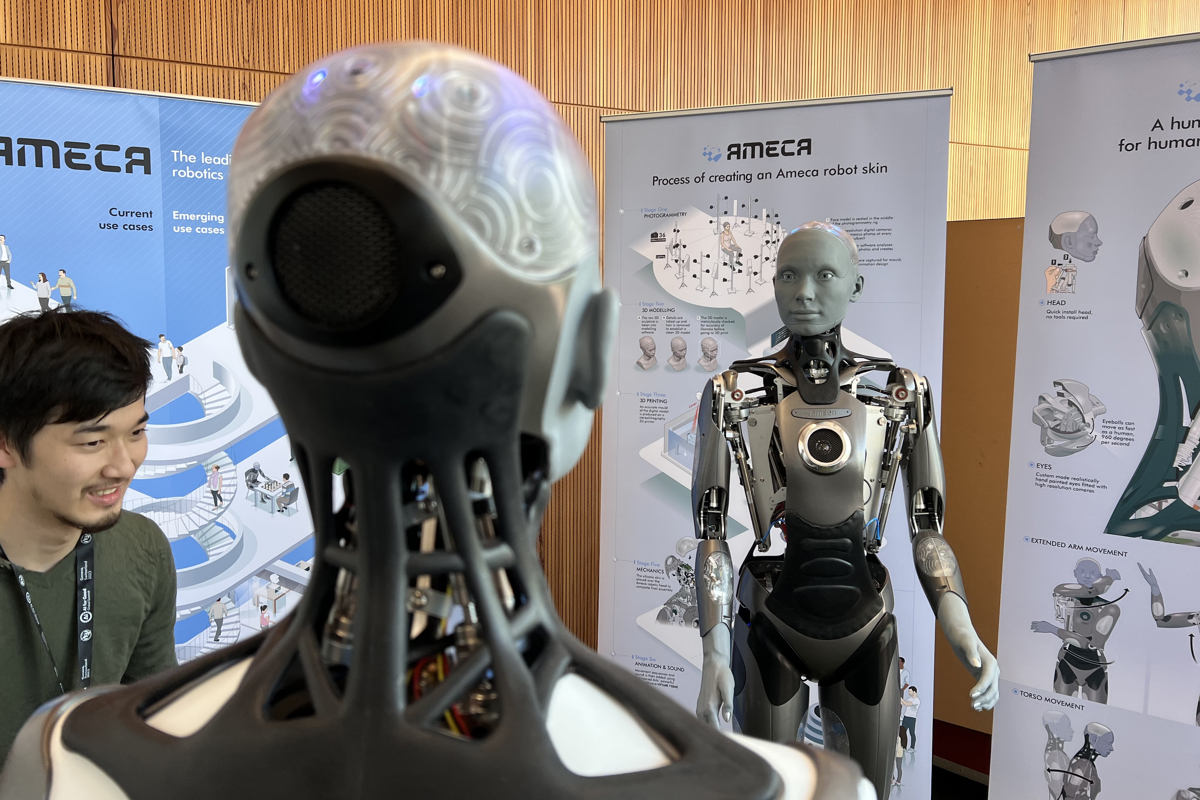

De ciencia ficción a la realidad

Por su parte, Jimena Sofía Viveros Álvarez, jefa de gabinete y asesora legal principal de la juez Loretta Ortiz en la Corte Suprema de Justicia de México, usará su especialización en armas autónomas para participar en el subgrupo de desafíos y, además, participará en el subgrupo de gobernanza internacional de la IA.

La también abogada señala que en los últimos dos años la gente ha pasado de ver el tema de las armas y los robots como algo de ciencia ficción a un tema “más presente que futuro”.

“Lo que hemos visto en el último año es que es inminente y exponencial, y no podemos postergar ya esta conversación sobre la regulación internacional (de las armas en relación con la IA) porque ya nos está comiendo la tecnología”, añade.

Para Viveros, el riesgo más grande es para la vida humana, la integridad física y los derechos humanos.

“Hay que empezar la conversación en el punto de partida de cuáles son las decisiones que les podemos delegar a los sistemas de inteligencia artificial y cuáles no, por ejemplo, el tomar una vida humana o no. Estamos en un contexto de bastantes crisis humanitarias y proliferación de conflictos armados y creo que es importante preguntarnos cuál es el siguiente paso en la industria de armas”, concluyó la experta.